KI-Beben: Das Beste der 70er, 80er, 90er und die Hits von Suno

Themen: Film, TV & Presse, Künstliche Intelligenz |Das hier ist die japanische Sängerin Akiko Nakamura in einer TV-Show ca. 1981:

Es ist wenig über sie bekannt. Folgende Angaben habe ich von einer japanischen Fan-Webseite übersetzen lassen:

Akiko wurde am 10. März 1955 in Tokio, Japan, geboren. Ihre Eltern waren leidenschaftliche Musikliebhaber, und schon früh wurde sie von ihrer Mutter mit den Liedern von Hibari Misora vertraut gemacht. Die Musik berührte ihr Herz, und sie träumte davon, selbst auf der Bühne zu stehen. Mit 17 Jahren gewann Akiko Nakamura die Talentshow “Sternengeburt” und erregte die Aufmerksamkeit der Musikproduzenten. Ihr Debüt-Single “Kirschblüten Melodie” (Sakura Melody) wurde ein Hit und katapultierte sie in die Popmusikszene. Ihre helle, zarte Stimme und ihre charismatische Bühnenpräsenz machten sie zu einem der gefeierten Stars der Ära.

Akiko veröffentlichte zahlreiche Alben und Singles, darunter Hits wie “Nachtregen” und “Verlorene Träume”. Sie tourte durch ganz Japan und füllte die größten Konzerthallen. Doch der Ruhm hatte seinen Preis. Der Druck, immer perfekt zu sein, führte zu persönlichen Kämpfen und Selbstzweifeln.

Im Alter von 30 Jahren beschloss Akiko, sich aus der Öffentlichkeit zurückzuziehen. Sie heiratete ihren langjährigen Freund, den berühmten Schauspieler Hiroshi Tanaka, und zog sich aufs Land zurück. Dort widmete sie sich der Malerei und der Wohltätigkeitsarbeit. Ihre Musik lebt jedoch weiter, und ihre Fans erinnern sich an sie als eine der größten Popsängerinnen ihrer Zeit.

Tatsächlich ist “Sakura Melody” ein echtes Kleinod der “mellow 70s”:

Falls ihr des Japanischen nicht so mächtig seid – hier eine Übersetzung der Lyrics:

The cityscape with fallen leaves dancing in the distance

Do you remember the promise of that day?

The season of falling cherry blossoms

I fell in love for the first time with the pain of remembering.Sakura, Sakura

your kindness remains in my heart

Sakura Sakura

Even though time has passed, that day comes back to me like a dream.When I first met you, my heart fluttered

The aches of youth – when will they end?

The smiling future we drew together

The warmth of that day, lingering in my heart

Das Problem mit Akiko Nakamura (und keine Gummipunkte für alle, die es schon geahnt haben): Es gibt sie nicht. Oder besser: Ich habe sie erfunden (lassen).

Ladies and Gentlemen, meet Johnny Dean und “Old Shoe”.

Das Bild ist von MidJourney generiert, die Biographie von ChatGPT, die Lyrics hat DeepL übersetzt. Das Quartett der Künstlichen Intelligenz vervollständigt Suno – und darum geht es heute.

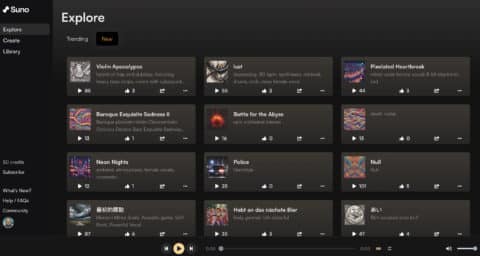

Ein Leser hat vorgestern auf die neue Kompositions-AI hingewiesen – und seither bin ich geflasht. Das lässt nicht nur ahnen, was bald möglich sein wird – es zeigt, was bereits möglich ist. Alles, was ich vor nicht mal anderthalb Jahren über KI-Musik geschrieben habe, ist damit Makulatur. Plattformen wie AIVA sind überholt und können so rückstandslos entfernt werden wie Wombi.AI nach der Entwicklung von MidJourney.

Okay, was ist es und wie funktioniert es?

Man kann sich einfach (z.B. mit einem Google-Account) anmelden, das ist die kostenlose Variante. Credits begrenzen die Menge an Songs, die man “komponieren” kann, aber die Credits laden sich mit der Zeit automatisch wieder auf. Wer mehr Kontrolle, die Rechte an den Songs und alle Freiheiten will, der kann ein kostenpflichtiges Abo abschließen.

Wer im Interface den “Custom Mode”-Button ungeklickt lässt, gibt ein, was er generieren will. Stil, Tempo, Instrumentierung, auch Wunsch auch Lyrics.

Frecher Girlie-Pop im Stil von Lily Allen über den Spaß auf der Toilette?

Deutschrap mit einem fetten Hook – was Cro kann, kann KI schon lange:

Man kann auch mal römische Legionäre Kampfeslieder schmettern lassen:

Lieber etwas smoothere Coffee Shop-Mucke?

Ostergesang von gestandenen Wikingern?

Ostern, Zeit der Freude | Suno

Miley Cyrus’ Mega-Hit “Flowers” auch mal als 80er-Synthwave?

Es gibt sogar eine “Ode an den Wortvogel”!

Man sieht: Die Möglichkeiten (innerhalb der aktuell vorgegebenen zwei Minuten Laufzeit) sind fast unbegrenzt. Mein erster Test war gleich ein epochales “main theme” für einen großen Science Fiction-Film, den ich nie schreiben werde:

Es werden wieder die kommen, die meinen, das sei alles nette Spielerei – weil sie den Ernst der Lage nicht erkennen. Weil sie so lange den Verkehr im Rückspiegel ignorieren, bis sie von ihm überholt werden. Phrasen wie “die menschliche Kreativität kann die Maschine gar nicht ersetzen” bis zu “das gehört verboten!” werden kommen.

Und sicher: Die Frage, inwieweit die Musik-KI Stile kopieren darf, ist genauso unbeantwortet wie bei MidJourney. Ist z.B. der Toilettenpop in meiner Liste oben so sehr Lily Allen ähnlich, dass Lily Allen sich zweckentfremdet vorkommen darf? Hat Suno kopiert oder hat Suno gelernt?

Zumindest erlauben die Erfahrungen mit ChatGPT und MidJourney eine erste grobe Einschätzung, an welchen Stellen Suno die Branche zuerst anknabbern wird. Weder Bruno Mars noch Taylor Swift brauchen sich aktuell Sorgen zu machen, weder Hans Zimmer noch Ludwig Göransson werden arbeitslos.

Zuerst einmal werden Dienste wie Suno bei der “stock music” aufräumen, wie MidJourney aktuell die Stock-Fotografie weitgehend überflüssig macht. Statt ewig in den Bibliotheken der Anbieter nach irgendwelchen “cues” zu suchen, die von der Atmosphäre und der Länge irgendwie zum produzierten Jingle, Spot oder Trailer passen, kann man sich die gewünschte Musik nun einfach selber generieren. Suno wird uns – ob wir das merken oder nicht – in der Werbung begegnen, im Radio, in Podcasts.

Dazu muss lediglich die Lizenzfrage rechtssicher geklärt werden und die Einstellungen für die Kompositionen müssen Verfeinerungen zulassen (exakte Länge, auf- und abschwellendes Ende, etc.).

Ebenfalls frischen Wind wird Suno im Bereich des Amateur- und semiprofessionellen Films bringen. Das wird keine Komponisten Arbeitsplätze kosten – erfahrungsgemäß werden sich zuerst jene Produktionen auf solche Tools stürzen, die sich Komponisten gar nicht leisten können und seit jeher auf Stock-Music oder heimisches Synthie-Gedudel beschränken mussten.

Ich hatte in der Richtung bereits eine Prognose abgegeben und tue das wieder: KI wird in den nächsten Monaten und Jahren dabei helfen, kleinere und mittlere Produktionen teilweise bis an die Grenzen zum Betrug edler aussehen zu lassen, als sie sind. Die KI wird die Plakate entwerfen, Pressetexte schreiben, Musik komponieren. Der tatsächliche Kern, der Film, wird dem oft genug gar nicht mehr entsprechen können.

Wie sehr das schon angekommen ist, sieht man u.a. am Vorspann von SECRET INVASION, der mit Hilfe von KI-Werkzeugen erstellt wurde:

Und der neue Horrorfilm LATE NIGHT WITH THE DEVIL hat Ärger bekommen, weil diverse Einspieler mit KI generiert wurden:

AI is here to stay. Get used to it.

Aber zurück zu Suno. Ich glaube, dass KI-Werkzeuge wie diese Plattform den Markt von unten aufrollen werden. Die Frage ist nur, ob es dabei bleibt, dass die KI einen breiten, aber dumpfen und anspruchslosen Bedarf deckt – oder ob am Ende nicht eben doch ausgeklügelte Kreativmaschinen stehen, deren Produkte auch mit den Geistesgrößen unserer und früherer Zeiten mithalten können.

Ich kann mich gut daran erinnern, dass Publikum, Presse und Programmierer in den 70ern begeistert waren, wie spielstark sich Schachcomputer entwickelten – aber gleichzeitig herrschte die Überzeugung, dass es für einen Sieg gegen einen menschlichen Großmeister nie reichen werde, weil die “brute force” des Programms der mentalen Eleganz des Genies nicht ebenbürtig sein könne.

Wir Menschen sitzen in einem brüchig werdenden Elfenbeinturm.

Ein weiterer Aspekt: Die Dudelmusik. Erst vor ein paar Monaten habe ich über die alberne Empörung eines Tagesschau-Podcasts geschrieben, der “Geistermusiker” bei Spotify entlarven wollte und damit lediglich Profis meinte, die unter Pseudonym am Fließband gefällige Hintergrundmusik für das Home Office oder den Coffee Shop schreiben. Spotify spart Geld, wenn die Zuschauer mehr “Hausmusik” hören als Superhits.

Nun: Spotify spart noch mehr Geld, wenn man auch die “Hausmusik” nicht einkaufen muss, sondern sie von einer KI (im Zweifelsfall sogar “ad hoc”) generieren lassen kann. Musik ohne echte Identität braucht auch keinen Komponisten.

Den Vorteil hat dabei nicht nur die Plattform: Auch Zuschauer können sich deutlich passgenauer wünschen, was sie hören möchten. Wenn etwas nicht bereit steht, wird es halt schnell hergestellt – und danach archiviert oder gelöscht.

Auch hier ein konkretes Beispiel. Die LvA hört bei der Arbeit nebenher gerne YouTube-Kanäle wie diesen:

Ich kann nicht mal sagen, ob das durch KI ersetzt werden kann – oder schon KI ist. Auf jeden Fall wird es in absehbarer Zeit KI sein.

Ich hatte es oben schon angedeutet: KI wird Taylor Swift nicht ersetzen, niemals den Status der Rolling Stones oder der Beatles haben. Man wird keine KI-Alben sammeln und ich bezweifle, ob ein per KI erzeugtes Hologramm von Akiko Nakamura auf einer Welttournee viele Karten verkaufen würde.

Andererseits: vielleicht ist das der Punkt, an dem einfach meine Phantasie aufhört. Vielleicht werden es unsere Enkel dereinst völlig normal finden, dass ihre Popstars virtuelle Charaktere sind, die man sich ins Kinderzimmer projizieren kann. Ed Sheeran und Super Mario – wo ist da genau genommen der Unterschied? Vielleicht wird man aber auch die mentalen und emotionalen Befindlichkeiten der User messen und direkt in die perfekte, individualisierte Musik umwandeln können. Musik als passgenaue Reflexion des eigenen Charakters, ohne jegliches verbindendes Element mit anderen Menschen. Traum oder Alptraum?

Ja, wir sind noch nicht soweit. Aber es wäre naiv zu glauben, dass wir nicht auf dem Weg sind – mit großen Schritten.

Weitere gute Artikel zum Thema gibt es beim ZDF und bei Rolling Stone.

Ich denke das wird am Ende einfach eine Frage der Generation sein. Für uns wird KI echte Musiker nicht ersetzen, aber die kommende Generation, die mit K.I. aufwächst, wird ja vielleicht einen ganz anderen Zugang zum Thema Musik finden. So wie Videos dank TikTok und Texte seit Facebook und Co. für junge Menschen zu flüchtigen Medien geworden sind – einmal schauen, emotional reagieren, weiterscrollen – hören sie dann eben auch nicht mehr bestimmte Stars und Bands, sondern die unendliche K.I. generierte Playlist. Maximal gibt es noch das Portal, dass die KI-Knoten sammelt, um später darauf zugreifen zu können; aber da spricht vielleicht auch schon wieder der 40jährige in mir…

Oder es kommt doch alles ganz anders. Wir werden es erleben. Spannende Zeiten.

Wer eine Ahnung davon bekommen möchte, wie wir vielleicht in Zukunft mit virtuellen Stars umgehen, muss nur nach Japan schauen, da gab‘s das schon vor gut 15 Jahren. https://en.wikipedia.org/wiki/Hatsune_Miku

Yup. Kombiniere KI mit Vocaloid und es wird demnächst vollgenerierte Sänger(innen) geben, die den Stars Stück für Stück die Hallen wegnehmen.

Das Publikum ist mit Miku schon an Kunstfiguren und Avatare auf der Bühne gewöhnt worden. Wem wird’s schon auffallen, wenn Hololive zwischen den noch von Menschen gesteuerten Avataren dann auch KI hat? https://en.wikipedia.org/wiki/Hololive_Production

Auf Twitch streamt Neurosama schon jetzt. https://en.wikipedia.org/wiki/Neuro-sama

Haha, an Hatsune Miku musste ich auch bei dem Absatz „ und ich bezweifle, ob ein per KI erzeugtes Hologramm von Akiko Nakamura auf einer Welttournee viele Karten verkaufen würde“ direkt denken. Die Japaner sind da schon wieder ein Stück weiter 😀

Die Japaner sind ja auch ein Stück verrückter.

Also bei allen diesen Songs ist der Gesangsrhythmus off.

Ich will gar nicht behaupten, dass das hier nicht schon jetzt beindruckend ist, aber noch braucht das Arbeit.

Aber stimmt schon, wenn man den “Gehdanken”, so wie es jetzt ist, einem Profi in die Hand geben würde, dann hätte der vermutlich nach sehr kurzer Studiozeit einen voll chartauglichen Song fertig.

Für die (sehr nahe) Zukunft wirst Du aber recht haben, die KI wird sehr viel ersetzen.

Nur da, wo sich die durchsetzen, die die KI beschränken wollen, da wird es dann immer noch Menschen erfordern.

Bei den Bildern haben wir ja schon gewollte Filter aktiviert (Waffen, Erotik, z.B.) und das wird jeglicher anderen Anwendung auch drohen.

Ich seh schon die Entschuldigungsnachricht vor mir, die erklärt warum harter Deutschrap nicht geht.

Alles, was aber themenfrei ist, wird der Computer machen.

Die Filter hast Du nur bei Web-Anwendungen, weil die Betreiber natürlich Angst vor schlechter Presse haben. Und auch da schon unterschiedlich stark. Auf KI-Fickelchat Seiten wie spicychat ist Erotik z.B. kein Problem. Bilderzeugung auf dem Heim-PC gibt es auch schon in der filterlosen Version. Wenn in 3-4 Jahren die PCs stärker auf KI ausgerichtet sind, wird man sehr viel ganz ohne Beschränkungen auf dem heimischen PC machen können.

Naja, ich hatte dir das mit den Song-KIs schon Ende Februar geschickt 😉 😀

Sorry, das ist durchgerutscht.

Der aktuelle Hans Zimmer sicher nicht, der hat den Durchbruch ja schon geschafft. Aber wie sieht’s mit dem nächsten Hans Zimmer aus?

Meiner naiven Vorstellung nach haben sich Nachwuchskomponisten eben genau an diesen “billigen” Produktionen versuchen dürfen, um zu beweisen, was sie können. Außerdem konnte man sich dann mit Jingles o.ä. über Wasser halten. Das hat einerseits Exposure gebracht, andererseits Übung.

Diese Spielfelder fallen jetzt ersatzlos weg. Damit wird das Risiko, den Karriereweg “Komponist” einzuschlagen, ungleich höher. Parallelen zum Journalismus drängen sich auf: Da sind die “Ausweichfelder” im Lokaljournalismus auch stark geschrumpft. Meiner Meinung nach hat das die Qualität im gesamten Feld merkbar reduziert.

Würde sich also der junge Hans Zimmer in die Tonwerkstatt vom alten Hans Zimmer bewerben, oder eher sagen, dass ihm das zu riskant ist?

E: Allein dass es weniger Stellen geben wird, hat ja Auswirkungen auf den verfügbaren Pool an Komponisten. – Je weniger Komponisten, desto weniger wahrscheinlich ist der nächste Ludwig Göransson.

Das wird man sehen.

Im Prinzip war es doch schon immer so, dass von 100 Leuten mit dem Talent Hans Zimmers (Til Schweiger, Kevin Kuranyi, …) wenn es hoch kommt einer der nächste Hans Zimmer wird und die 99 anderen Taxi-Fahrer – es gehört halt noch viel mehr dazu als Talent, insbesondere auch glückliche Zufälle. Für mich ist die Essenz von KI, dass das gleiche Ergebnis mit weniger Qualifikation (oder doch Talent?) erreicht werden kann, das lässt die Möglichkeit offen, dass entweder ein besseres Ergebnis erreicht wird (Der ähnlich talentierte Hans Zimmer jr. haut eine heute noch gar nicht vorstellbare Dimension von Musik raus) oder dass tatsächlich nur der “Pool” größer wird. Ob das jetzt gut oder schlecht ist lässt sich nicht so leicht sagen, dazu gehört dann halt nämlich auch dass nicht nur Hans Zimmer aus wohlhabendem Elternhaus und guter Ausbildung im Pool ist sondern auch José Sala aus Puerto Rico.

Wir benutzen in unserer Rollenspielrunde bereits SDXL um Szenen aus dem Spiel oder Charaktere “zeichnen” zu lassen.

Jetzt kann ich als Spielleiter mir auch noch die Musik für jede Szene erstellen lassen.

Grandios!

Wer sich nur durch diesen Text noch nicht alt fühlt: Oasis’ whatever wird dieses Jahr 30…

Die haben ihre Schäfchen im Trockenen.